Erstellt am: 17. 11. 2016 - 18:49 Uhr

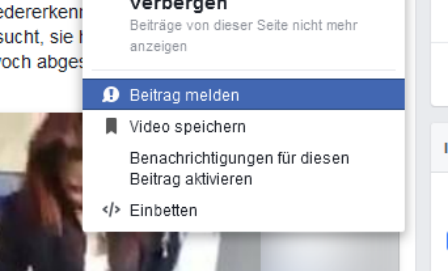

Gemeldeter Content auf Facebook

Das Video einer 15-jährigen, die vergangene Woche in Wien-Kagran von vier Jugendlichen verprügelt wurde, wurde von vielen NutzerInnen gemeldet. Der Clip wurde aber von Facebook zunächst nicht gelöscht, mit dem Hinweis, dass das Video nicht gegen die Gemeinschaftsstandards von Facebook verstößt.

Screenshot Facebook

Wir wollten von Facebook selbst wissen, warum das Video trotz zahlreicher Meldungen weiterhin online war. Eine Facebook-Sprecherin hat uns schließlich heute noch überraschend geantwortet.

Die Facebook-Sprecherin, von der wir Auskunft bekommen haben, wollte anonym bleiben.

Zum konkreten Fall mit der verprügelten Jugendlichen

Die Facebook-Sprecherin räumt ein, dass immer wieder verstörende Inhalte auf Facebook geteilt werden, beruft sich aber hier auf den Punkt "Gewalttätige und Explizite Inhalte" in den Gemeinschaftsstandards: "Wenn Menschen solche Inhalte teilen, tun sie dies oft, um dies zu verurteilen. Wenn solche Inhalte aus sadistischem Vergnügen oder zum Zwecke der Gewaltverherrlichung geteilt werden, dann löscht Facebook sie. Schnell. In dem vorliegenden Fall ist der Post aber eindeutig gegen diese Gewalt."

Im konkreten Fall schlägt offenbar das "öffentliche Interesse" an dem Video den Passus aus den Gemeinschaftsstandards, der Mobbing dezidiert untersagt.

Es gibt auf Facebook auch Grenzen, die nicht überschritten werden dürfen. Die Sprecherin führt aber aus, dass die "Kritik an einer bestimmten Kultur, Religion, Lebensstil oder politischer Ideologie" noch allein kein Grund sei, solche Diskussionen zu entfernen. "Wir glauben fest daran, dass Facebook-Nutzer die Möglichkeit haben, ihre Meinung zu äußern, und dass wir in der Regel diese Inhalte, Gruppen oder Seiten, die sich gegen Länder, Religionen, politischen Organisationen oder Ideen richten, nicht entfernen", erklärt die Facebook-Sprecherin.

Dass man damit in einigen Ländern mit der Rechtssprechung in Konflikt gerät, nimmt man scheinbar in Kauf. Die Sprecherin erklärt jedoch, dass man in gewissen Fällen mit Behörden zusammenarbeite. Wie das funktioniert, steht hier.

Facebook hat uns auch einen Link gesendet, bei dem auch Nicht-Facebook-NutzerInnen Privatsphäre-Verletzungen melden können (zB Recht am eigenen Bild).

Zum Umgang mit Hatespeech

Facebook mit seinen mehr als einer Milliarde NutzerInnen birgt auch Konfliktpotenzial, erklärt die Sprecherin. Sie betont: "Nichts ist für uns so wichtig wie die Sicherheit der Menschen auf Facebook. Gegen Nutzer, die anderen Personen Gewalt androhen, werden wir konsequent vorgehen. Mit den geeigneten Maßnahmen, in Kooperation mit starken Partnern und in Absprache mit Behörden und Politik. Auch unsere Prozesse im Bereich Community Operations (siehe nächster Punkt) werden wir prüfen und wenn nötig anpassen."

Facebook Deutschland ist seit Ende September 2015 volles Mitglied der Freiwilligen Selbstkontrolle Multimedia-Diensteanbieter (FSM). "In diesem Rahmen findet ein regelmäßiger Austausch zwischen Mitarbeitern des Facebook Community Operations Teams und Juristen der FSM-Beschwerdestelle statt", erklärt die Sprecherin. Schwerpunkt der Diskussion sollen die relevanten Rechtsgrundlagen und deren Auslegung hinsichtlich von Inhalten in sozialen Netzwerken sein, bei denen zwischen Meinungsfreiheit und dem Schutz anderer grundgesetzlich geschützter Rechte, etwa dem Persönlichkeitsrecht und der Menschenwürde, abzuwägen ist.

"Community Operations Team"

Das sind jene Leute, die gemeldete Inhalte begutachten. Laut Angaben der Facebook-Sprecherin, sind es Leute, die die Sprache des jeweiligen Inhalts als ihre Muttersprache haben. Die Community Operation Teams sind auf vier Standorte verteilt: Dublin, Hyderabad, Austin und Menlo Park. Angeblich arbeiten dort tausende Menschen rund um die Uhr daran, gemeldete Beiträge anzusehen.

Welcher gemeldete Content gelöscht wird

Auch wenn Facebook betont, dass Muttersprachler die jeweiligen Inhalte ansehen, wird von einigen Seiten vermutet, dass die dort Angestellten teilweise kulturell zu wenig sensibilisiert bzw. unqualifiziert sind.

Ein geleaktes Dokument aus dem Jahr 2012 gibt einen Einblick darüber, an welche Kriterien sich die Moderatoren halten müssen. Neben vielen nachvollziehbaren Ausschlusskriterien, wie zum Beispiel der Verbreitung kinderpornografischen Materials oder der Darstellung von Nekrophilie, finden sich auf der Liste aber auch diskutable Punkte.

Erlaubt sind etwa Bilder von:

- männlichen Brustwarzen

- zerquetschten Köpfen, Gliedmaßen sind ok, solange keine Innereien sichtbar sind.

- Körperflüssigkeiten, außer Sperma

- tiefen Fleischwunden und viel Blut ("excessive blood")

- brennenden Flaggen, außer jener der Türkei

Nicht erlaubt sind:

- weibliche Brustwarzen

- stillende Mütter, bei denen Nippel zu sehen sind

- sichtbare Po-Ritzen ("naked butt cracks")

- das offensichtliche Zeigen von camel toes und moose knuckles

- Bilder, die Kemal Atatürk diskreditieren

Zwar ist die Liste schon ein bisschen älter und vermutlich in der Zwischenzeit auch aktualisiert worden, dennoch bietet sie einen kleinen Einblick in die Arbeit der ModeratorInnen, und womit diese sicherlich auch heute noch tagtäglich konfrontiert sind. Genug Fragen bleiben bei einem Blick auf die Liste dennoch offen.

"Es wird Urteile hageln"

Wie wir mit Gewaltvideos auf Facebook umgehen

Im Gespräch mit Rat Auf Draht- und Safer Internet-Psychologin Elke Prochazka

Die Grünen wollen Facebook nun wegen des Umgangs mit dem Gewalt-Video klagen. Dabei soll der heuer in Österreich eingeführte Cybermobbing-Paragraf zum Einsatz kommen.

Eine Sachverhaltsdarstellung wurde vom Grünen Parlamentsklub gestern eingereicht, der Ball liegt jetzt also bei der Justiz. Falls es zu einem Prozess kommt, könnte das Ergebnis wegweisend dafür sein, welche Verantwortung Soziale Medien künftig für solche Inhalte tragen müssen.

"Langfristig muss diskutiert werden, was die Verantwortlichkeit der Plattformen ist", meint Max Schrems, der ja schon Erfahrung darin hat, Facebook zu klagen. Er ist gespannt, zu welchem Ergebnis die Anzeige der Grünen führen wird und überzeugt, dass diese mit ihrer Klage nicht alleine bleiben werden. Denn Facebook sei "inzwischen für große Teile der Bevölkerung eine wichtige Nachrichtenquelle geworden. Ich glaube, da wird es in den nächsten Jahren Urteile hageln."